流程

安装Ollama

Ollama是一个开源的本地大模型运行框架,用于在本地部署、管理和运行各类开源LLM模型

下载地址:https://ollama.com/download,支持macOS, Linux 和 Windows 系统

下载模型

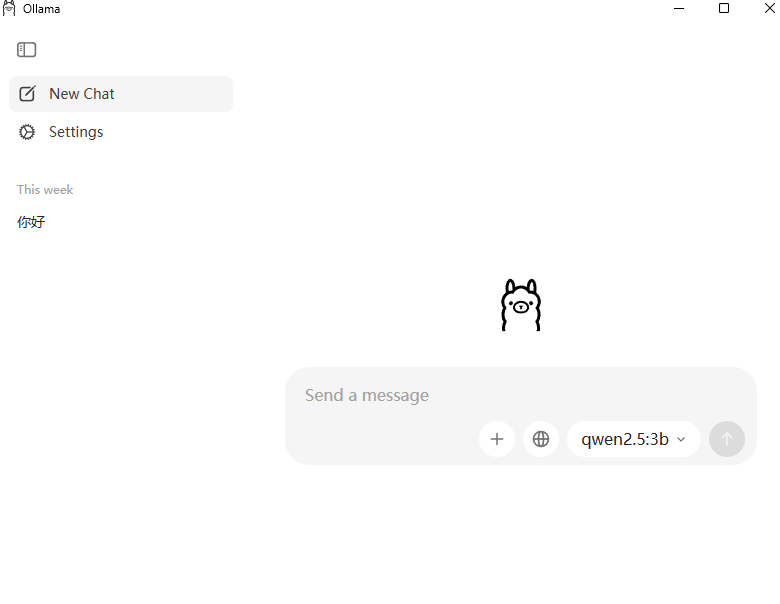

打开Ollama聊天页面: 直接选择需要下载的模型

建议优先选择一个小模型跑起来: 在find model中输入:qwen2.5:3b,下载即可

更改模型下载位置:模型默认下载到C盘,所以可以点击Settings进行自定义路径的设置 模型越大,性能越好,但是消耗的就越高

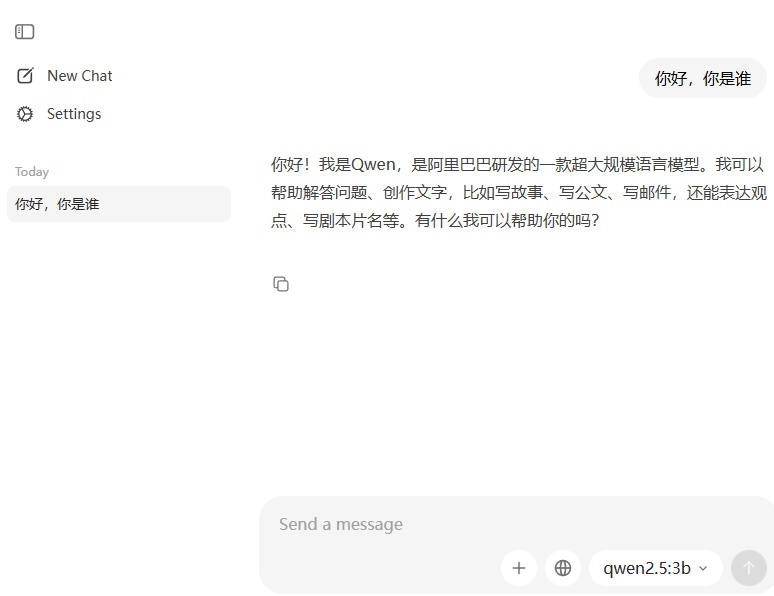

模型下载完毕之后,即可在对话框输入消息开启对话(还可以联网操作)

Dify配置Ollama

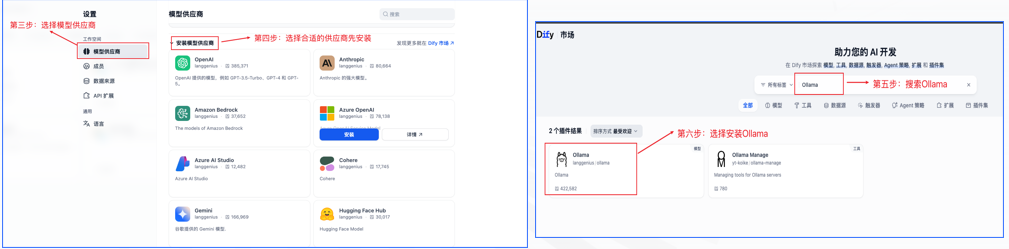

登陆 Dify 进行设置

在Dify市场中搜索Ollama 模型供应商进行安装

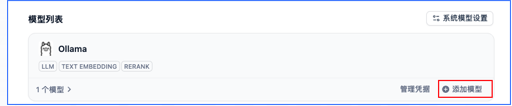

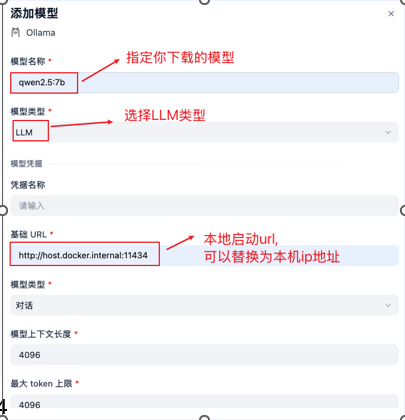

在模型列表中,找到安装好的Ollama添加模型

注意:同一机器部署:

http://host.docker.internal:11434不同机器部署:http://192.168.x.x(自己IP):11434

由于这里dify部署在服务器,Ollama部署在本地,又处于校园网环境下,需要内网穿透,将两者端口打通,这里不进行示范